В Google рассказали о важных обновлениях поисковых алгоритмов

Поисковая строка будет лучше распознавать опечатки пользователей, а новая функция расскажет, что за песня засела у вас в голове.

На мероприятии Google Search On 2020 разработчики компании рассказали о самых важных нововведениях, которые коснутся поисковых и других сервисов компании. Пожалуй, самая важная из них касается улучшения алгоритма распознавания орфографии в запросах пользователей в Google.

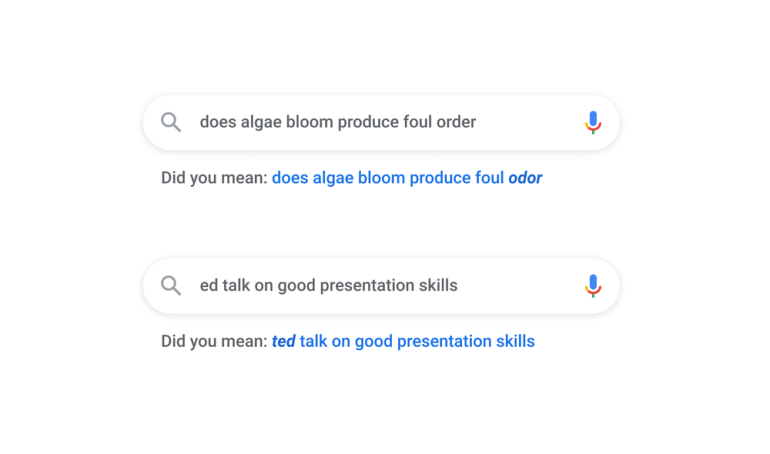

По словам Кэти Эдвардс, вице-президента Google по разработке, примерно 10% запросов содержат орфографические ошибки. На этот случай у поисковой системы есть функция «Возможно, вы имели в виду:», предлагающая верное написание запроса. Уже к концу октября эта опция получит обновление — новый алгоритм на основе нейронной сети с 680 миллионами параметров.

Это новшество в компании характеризуют как «крупнейший прорыв за последние пять лет». Алгоритм будет срабатывать менее чем через три миллисекунды после запроса, и даст еще более точные результаты, максимально соответствующие потребностям человека. Правда, сперва данное обновление будет доступно лишь для запросов на английском языке.

Заметное обновление коснется индексации данных: теперь поисковые роботы Google смогут индексировать не только веб-страницы в целом, но и отдельные их разделы. Эта технологии, в отличии от улучшения обработки орфографии, будет внедряться для запросов на всех языках. По словам разработчиков, благодаря этому качество выдачи по запросу возрастет на 7%.

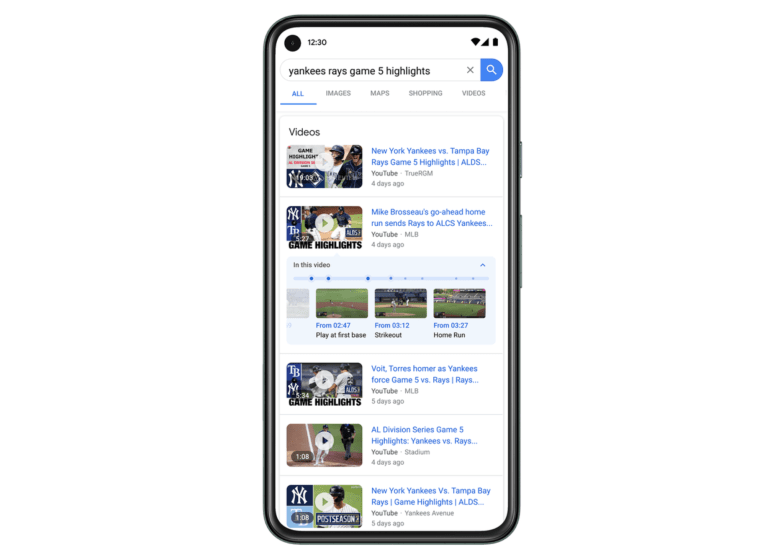

Алгоритмы поиска по видео также меняются к лучшему, Теперь поисковая система Google будет использовать распознавание речи и методики компьютерного зрения для определения содержания и выделения ключевых моментов в видеороликах. Благодаря этому, например, видео с пошаговыми инструкциями приготовления еды или записи спортивных событий можно будет легко разделять на главы. Благодаря такой технологии пользователь сможет посмотреть нужную часть видео, не проматывая его.

Для тех, кто часто напевает себе под нос какую-то песню и никак не может вспомнить ее слова или название, Google предложит функцию Hum to Search. Достаточно просто максимально похоже пропеть мелодию: специальная нейронная сеть, натренированная на поиск совпадений по звукам выдаст наиболее вероятный вариант музыкального трека.

Разработке, которая лежит в основе Hum to Search, уже несколько лет. Впервые приложение, действующее по аналогичным алгоритмам, появилось еще в 2017 году на смартфонах Pixel 2 от Google. Сейчас Hum to Search уже доступна в мобильном приложении Google на ОС Android и iOS.

Также стоит упомянуть изменения в сервисе Google Maps: теперь пользователи смогут увидеть на картах информацию о загруженности мест в реальном времени. Это обновление связано с коронавирусной пандемией: проанализировав данные активности пользователей с марта по май текущего года, специалисты компании увидели, что люди в полтора раза чаще стали взаимодействовать с инструментами и сервисами, которые дают информацию о посещаемости магазинов, ресторанов, клубов и других публичных пространств.

После обновления Google Maps будут показывать загруженность не только заведений или торговых точек , но также и пляжей, парков и других мест для отдыха на открытом воздухе. В ближайшее время функция станет доступной на Android, iOS и пользователям настольных ПК по всему миру.

Ранее мы также писали о том, что специалисты Google создадут квантовый компьютер для моделирования червоточины, а в браузере Google Chrome появилась функция, показывающая веб-страницы глазами дальтоников и слабовидящих.

Нашли опечатку? Выделите фрагмент и нажмите Ctrl + Enter.