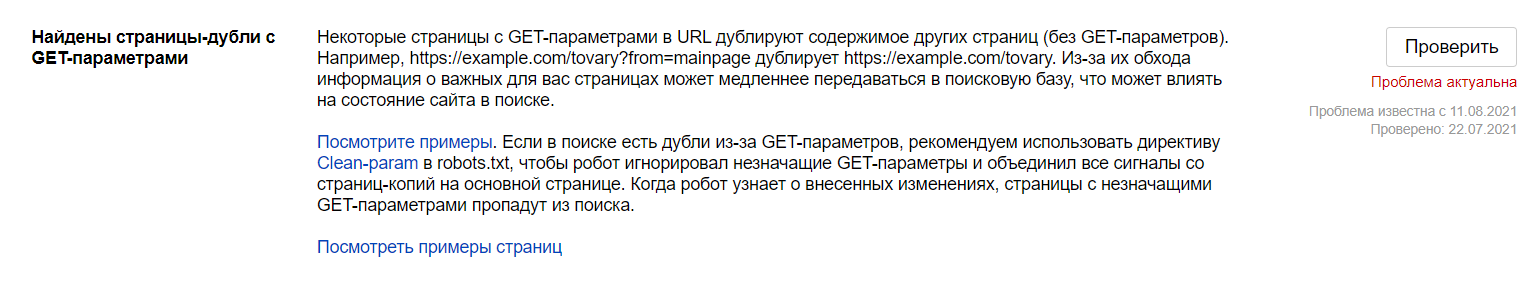

Теперь находить одинаковые страницы на сайте стало проще: в разделе «Диагностика» Яндекс.Вебмастера появилось специальное уведомление, которое расскажет про дубли из-за GET-параметров.

Подписываться на оповещения не нужно, уведомление появится само. Если обнаружены дубли:

- Нужно перейти в Вебмастер, открыть раздел Страницы в поиске, в таблице выберать Исключенные страницы.

- Загрузить архив (подходящий формат можно выбрать внизу страницы) и просмотреть скачанный файл: у страниц-дублей будет статус DUPLICATE.

Зачем отслеживать дубли

- Скорость обхода. Когда на сайте много дублей, роботы тратят больше времени и ресурсов на их обход, вместо того, чтобы обходить ценный контент. А значит, ценные страницы сайта будут медленнее попадать в поиск.

- Неуправляемость. Так как поисковой робот произвольно выбирает, какой из дублей показывать в поиске, то на поиск могут попасть не те страницы, которые нужны.

- Влияние на поиск. Если незначащие параметры не добавлены в clean-param, робот может обходить эти страницы и считать их разными, не объединяя их в поиске. Тогда поисковый робот будет получать разные неагрегируемые сигналы по каждой из них. Если бы все сигналы получала одна страница, то она имела бы шансы показываться выше в поиске.

- Нагрузка на сайт. Лишний обход роботом также дает нагрузку на сайт.

Как оставить в поиске нужную страницу

1. Добавить в файл robots.txt директиву Clean-param, чтобы робот не учитывал незначащие GET-параметры в URL. Робот Яндекса, используя эту директиву, не будет много раз обходить повторяющийся контент. Значит, эффективность обхода повысится, а нагрузка на сайт снизится.

2. Если нет возможности добавить директиву Clean-param, нужно указать канонический адрес страницы, который будет участвовать в поиске. Это не уменьшит нагрузку на сайт: роботу Яндекса все равно придется обойти страницу, чтобы узнать о rel=canonical. Поэтому рекомендуется использовать Сlean-param как основной способ.

3. Если по каким-то причинам предыдущие пункты не подходят, можно просто закрыть дубли от индексации при помощи директивы Disallow. Но в таком случае поиск Яндекса не будет получать никаких сигналов с запрещенных страниц. Поэтому все-таки лучше использовать Сlean-param как основной способ.

Подробнее о работе со страницами-дублями можно прочесть в Справке.

Напомним, весной в Яндекс.Вебмастере появились инструменты, помогающие быстро найти страницы с дублирующимися тегами title и description.